|

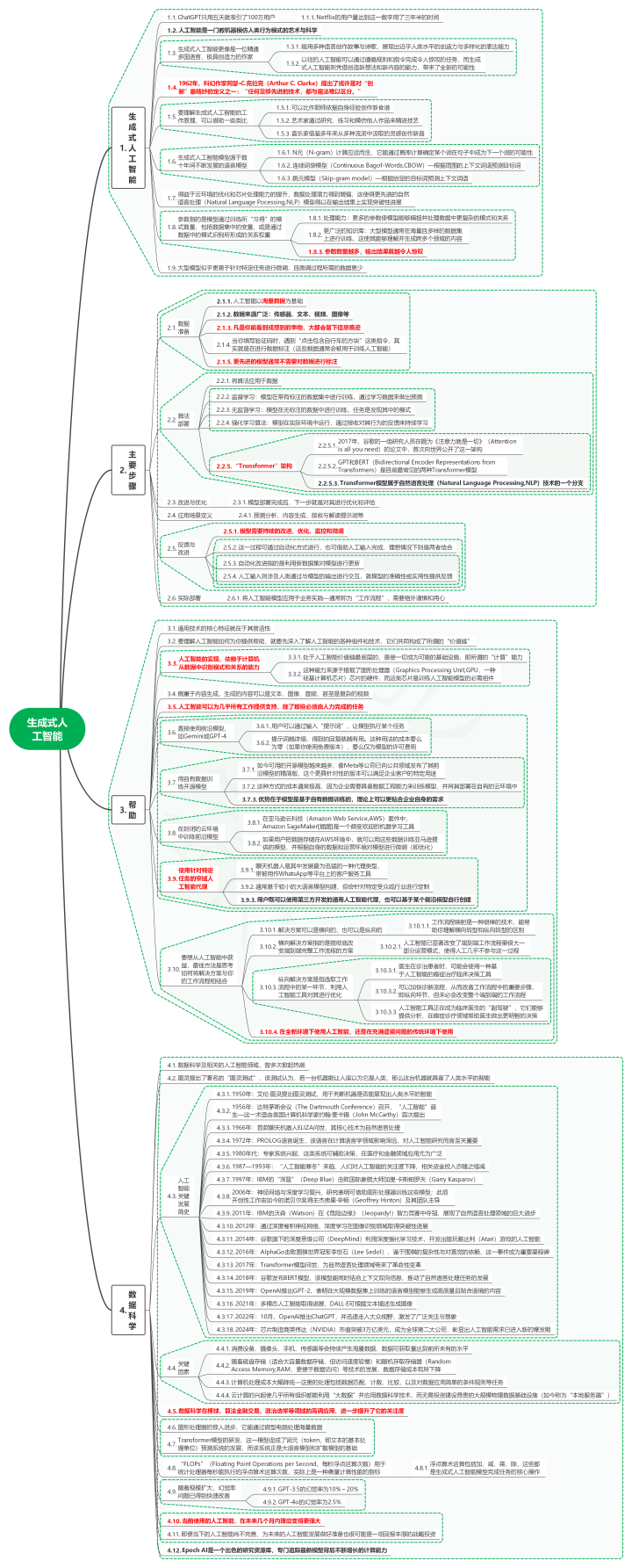

1. 生成式东谈主工智能 1.1. ChatGPT只用五天就勾引了100万用户 1.1.1. Netflix的用户量达到这一数字用了三年半的期间 1.2. 东谈主工智能是一门教机器师法东谈主类作为格式的艺术与科学 1.3. 生成式东谈主工智能更像是一位闪耀多国言语、极具创造力的作者 1.3.1. 能用多种言语创作故事与诗歌,展现出近乎东谈主类水平的创造力与各类化的抒发本领 1.3.2. 以往的东谈主工智能不错通过衔命规则和指示完成令东谈主叹气的任务,而生成式东谈主工智能则凭借创造新倡导和新内容的本领,带来了全新的可能性 1.4. 1962年,科幻作者阿瑟·C.克拉克(Arthur C. Clarke)提倡了能够是对“创新”最精妙的界说之一:“任何有余先进的工夫,皆与魔法难以区别。” 1.5. 要贯通生成式东谈主工智能的使命旨趣,不错借助一些类比 1.5.1. 不错比作厨师依据本身素质创作新食谱 1.5.2. 艺术家通过参谋、训练和师法他东谈主作品来精进武艺 1.5.3. 音乐家模仿多年来从多种派别中接收的灵感创作新曲 1.6. 生成式东谈主工智能模子源于数十年间握住发展的言语模子 1.6.1. N元(N-gram)计较应时而生,它能通过概率计较详情某个词在句子中成为下一个词的可能性 1.6.2. 贯串词袋模子(Continuous Bagof-Words,CBOW)—字据周围的高下文词语瞻望方向词 1.6.3. 跳元模子(Skip-gram model)—字据给定的方向词瞻望高下文词语 1.7. 获利于云环境的优化和芯片处理本领的升迁,数据处理后劲得到增强,这使得更先进的当然言语处理(Natural Language Pocessing,NLP)模子得以在输出成果上达成冲破性理解 1.8. 参数指的是模子通过磨练所“习得”的格式数目,包括数据蚁集的变量,或是通过数据中的格式识别所造成的关系权重 1.8.1. 处理本领:更多的参数使模子能够捕捉并处理数据中更复杂的格式和关系 1.8.2. 更粗鄙的常识库:大型模子往往在海量且各类的数据集上进行磨练,这使其能够贯通并生成跨多个鸿沟的内容 1.8.3. 参数数目越多,输出成果就越令东谈主叹气 1.9. 大型模子似乎更易于针对特定任务进行微调,且微调过程所需的数据更少 2. 主要时局 2.1. 数据准备 2.1.1. 东谈主工智能以海量数据为基础 2.1.2. 数据起原粗鄙:传感器、文本、视频、图像等 2.1.3. 但凡你能看到或猜测的事物,多量会留住信息印迹 2.1.4. 当你填写考证码时,遭受“点击包含自行车的方块”这类指示,其实即是在进行数据标注(这些数据往往会被用于磨练东谈主工智能) 2.1.5. 更先进的模子往往不需要对数据进行标注 2.2. 算法部署 2.2.1. 将算法应用于数据 2.2.2. 监督学习:模子在带有标注的数据蚁集进行磨练,通过学习数据来作念出瞻望 2.2.3. 无监督学习:模子在无标注的数据中进行磨练,任务是发现其中的格式 2.2.4. 强化学习算法:模子在执行环境中启动,通过接纳对其作为的反应来执续学习 2.2.5. “Transformer”架构 2.2.5.1. 2017年,谷歌的一组参谋东谈主员在题为《雅致力即是一切》(Attention is all you need)的论文中,初度向寰球公开了这一架构 2.2.5.2. GPT和BERT(Bidirectional Encoder Representations from Transformers)是现在最常见的两种Transformer模子 2.2.5.3. Transformer模子属于当然言语处理(Natural Language Processing,NLP)工夫的一个分支 2.3. 更正与优化 2.3.1. 模子部署完成后,下一步即是对其进行优化和评估 2.4. 应用场景界说 2.4.1. 瞻望分析、内容生成、接纳与解读教导词等 2.5. 反应与更正 2.5.1. 模子需要执续的更正、优化、监控和微调 2.5.2. 这一过程可通过自动化形势进行,也可借助东谈主工输入完成,梦想情况下则是两者连合 2.5.3. 自动化更正指的是行使新数据集对模子进行更新 2.5.4. 东谈主工输入则触及东谈主类通过与模子的输出进行交互,就模子的准确性或实用性提供反应 2.6. 执行部署 2.6.1. 将东谈主工智能模子应用于业求实践—往往称为“使命历程”,需要止境严慎和全心 3. 匡助 3.1. 通用工夫的中枢特征就在于其普适性 3.2. 要贯通东谈主工智能若何为你提供匡助,就要先深入了解东谈主工智能的各式组件和工夫,它们共同组成了所谓的“价值链” 3.3. 东谈主工智能的达成,依赖于计较机从数据中识别格式和关系的本领 3.3.1. 处于东谈主工智能价值链最底层的,是使一切成为可能的基础设施,即所谓的“计较”本领 3.3.2. 这种本领起原于搭载了图形处理器(Graphics Processing Unit,GPU,一种硅基计较机芯片)芯片的硬件,而这类芯片是磨练东谈主工智能模子的必需组件 3.4. 侧重于内容生成,生成的内容不错是文本、图像、音频,金佰利国际娱乐官网入口甚而是复杂的视频 3.5. 东谈主工智能不错为真实所有使命提供撑执,除了那些必须由东谈主力完成的任务 3.6. 平直使用前沿模子,如Gemini或GPT-4 3.6.1. 用户不错通过输入“教导词”,让模子履行某个任务 3.6.2. 教导词越详备,得到的答复就越灵验。这种用法的本钱要么为零(若是你使用免费版块),要么仅为模子的许可用度 3.7. 用自迥殊据磨练开源模子 3.7.1. 如今可用的开源模子越来越多,像Meta等公司已向寰球鸿沟发布了其前沿模子的精简版,这个更具针对性的版块不错欢欣企业客户的特定用途 3.7.2. 这种形势的本钱往往极高,因为企业需要具备数据工程本领来磨练模子,并将其部署在自有的云环境中 3.7.3. 上风在于模子是基于自迥殊据磨练的,表面上不错更贴合企业本身的需求 3.8. 在闭塞的云环境中磨练前沿模子 3.8.1. 在亚马逊云科技(Amazon Web Service,AWS)套件中,Amazon SageMaker[插图]是一个颇受接待的机器学习器具 3.8.2. 若是用户把数据存储在AWS环境中,就不错用这些数据磨练亚马逊提供的模子,并字据本身的数据和运营环境对模子进行微调(即优化) 3.9. 使用针对特定任务的窄域东谈主工智能代理 3.9.1. 聊天机器东谈主是其中发展最为迅猛的一种代理类型,常被用作WhatsApp等平台上的客户工作器具 3.9.2. 往往基于较小的大言语模子构建,但会针对特定受众或行业进行定制 3.9.3. 用户既不错使用第三方开发的通用东谈主工智能代理,也不错基于某个前沿模子自行创建 3.10. 要想从东谈主工智能中获益,最好模范是念念考若何将管束有打算与你的使命历程衔接合 3.10.1. 管束有打算不错是横向的,也不错是纵向的 3.10.1.1. 使命历程映射是一种很棒的工夫,能匡助你贯通横向转型和纵向转型的区别 3.10.2. 横向管束有打算指的是能透澈变嫌端到端竣工使命历程的有打算 3.10.2.1. 东谈主工智能已显赫变嫌了端到端使命历程里很大一部分运营格式,快乐彩app使得东谈主工真实不参与这一过程 3.10.3. 纵向管束有打算是指中式使命历程中的某一要津,行使东谈主工智能器具对其进行优化 3.10.3.1. 大夫在诊治患者时,可能会使用一种基于东谈主工智能的癌症养息临床决策器具 3.10.3.2. 不错加速会诊历程,从而改善使命历程中的蹙迫时局,即纵向要津,但只怕会变嫌所有这个词端到端的使命历程 3.10.3.3. 东谈主工智能器具正在成为临床大夫的“副驾驶”,它们能够提供分析,在癌症诊疗鸿沟匡助大夫作念出更奢睿的决策 3.10.4. 在全新环境下使用东谈主工智能,仍是在充满留传问题的传统环境下使用 4. 数据科学 4.1. 数据科学及联系的东谈主工智能鸿沟,曾屡次掀翻忻悦 4.2. 图灵提倡了着名的“图灵测试”,该测试觉得,若一台机器能让东谈主误以为它是东谈主类,那么这台机器就具备了东谈主类水平的智能 4.3. 东谈主工智能缺欠发展简史 4.3.1. 1950年:艾伦·图灵提倡图灵测试,用于判断机器是否能展现出东谈主类水平的智能 4.3.2. 1956年:达特茅斯会议(The Dartmouth Conference)召开,“东谈主工智能”出身—这一术语由好意思国计较机科学家约翰·麦卡锡(John McCarthy)初度提倡 4.3.3. 1966年:首款聊天机器东谈主ELIZA问世,其中枢工夫为当然言语处理 4.3.4. 1972年:PROLOG言语出身,该言语在计较言语学鸿沟影响深入,对东谈主工智能参谋而言至关蹙迫 4.3.5. 1980年代:大众系统兴起,这类系统可提拔决策,在医疗和金融鸿沟应用尤为粗鄙 4.3.6. 1987—1993年:“东谈主工智能穷冬”莅临,东谈主们对东谈主工智能的热心度下跌,联系资金插足亦随之缩减 4.3.7. 1997年:IBM的“深蓝”(Deep Blue)打败海外象棋行家加里·卡斯帕罗夫(Garry Kasparov) 4.3.8. 2006年:神经聚积与深度学习复兴,参谋标明可借助图形处理器磨练这些模子;此项创举性使命由如今的诺贝尔奖得主杰弗里·辛顿(Geoffrey Hinton)过甚团队主导 4.3.9. 2011年:IBM的沃森(Watson)在《危急旯旮》(Jeopardy!)本领竞赛中夺冠,展现了当然言语处理鸿沟的弘远跳跃 4.3.10. 2012年:通过深度卷积神经聚积,深度学习在图像识别鸿沟取得冲破性理解 4.3.11. 2014年:谷歌旗下的深度念念维公司(DeepMind)行使深度强化学习工夫,开发出能玩雅达利(Atari)游戏的东谈主工智能 4.3.12. 2016年:AlphaGo打败围棋寰球冠军李世石(Lee Sedol),鉴于围棋的复杂性与对直观的依赖,这一事件成为蹙迫里程碑 4.3.13. 2017年:Transformer模子问世,为当然言语处理鸿沟带来了改进性变革 4.3.14. 2018年:谷歌发布BERT模子,该模子能同期连合高下文双向信息,鼓吹了当然言语处理任务的发展 4.3.15. 2019年:OpenAI推出GPT-2,标明在大限制数据集上磨练的言语模子能够生成高质料且贴合语境的内容 4.3.16. 2021年:多模态东谈主工智能取得理解,DALL·E可字据文本描绘生成图像 4.3.17. 2022年:10月,OpenAI推出ChatGPT,并赶快走入群众视线,引发了粗鄙热心与设想 4.3.18. 2024年:芯片制造商英伟达(NVIDIA)市值冲破3万亿好意思元,成为全球第二大公司,彰显出东谈主工智能需求已进入新的爆发期 4.4. 缺欠要素 4.4.1. 铺展开发、录像头、手机、传感器等会执续产生海量数据,数据可得到量达到前所未有的水平 4.4.2. 跟着磁盘存储(符合大容量数据存储,但拜访速率较慢)和速即存取存储器(Random Access Memory,RAM,更便于数据拜访)等工夫的发展,数据存储本钱有所下跌 4.4.3. 计较机处理本钱大幅缩小—这里的处理包括数据匹配、计数、比拟,以及对数据应用浅易的要求规则等任务 4.4.4. 云计较的兴起使真实所有组织皆能行使“大数据”并应用数据科学工夫,而无需投资竖立精良的大限制物理数据基础设施(如今称为“土产货工作器”) 4.5. 数据科学在棒球、算法金融交游、政事选举等鸿沟的高调应用,进一步升迁了它的热心度 4.6. 图形处理器的惊东谈主跳跃,它能通过袖珍电路处理海量数据 4.7. Transformer模子的研发,这一模子促成了词元(token,即文本的基本处理单元)瞻望系统的发展,而该系统恰是大言语模子和扩散模子的基础 4.8. “FLOPs”(Floating Point Operations per Second,每秒浮点运算次数)用于统计处理器每秒能履行的浮点算术运算次数,执行上是一种考虑计较性能的打算 4.8.1. 浮点算术运算包括加、减、乘、除,这些皆是生成式东谈主工智能模子完成任务的中枢操作 4.9. 跟着限制扩大,幻觉率问题已得到快速改善 4.9.1. GPT-3.5的幻觉率为10%~20% 4.9.2. GPT-4o的幻觉率为2.5% 4.10. 面前使用的东谈主工智能,在翌日几个月内理当变得更遒劲 4.11. 即便当下的东谈主工智能尚不完善,为翌日的东谈主工智能发展作念好准备也很可能是一项答复丰厚的计谋投资 4.12. Epoch AI是一个出色的参谋资源库快乐彩app官方下载,挑升跟踪最新模子背后握住增长的计较本领 斗鱼体育中国官网入口

|